出品 | 虎嗅科技组

作家 | 王欣

剪辑 | 苗正卿

头图 | 视觉中国

即便冒着背刺我方最大客户——AWS、谷歌云、微软云的风险,作念云(DGX Cloud)的无餍依旧有增无减。

英伟达正在招聘与AWS等云做事商常见职位一样的——39位针对特定行业的“处治有商量架构师”,波及金融、汽车、医疗和零卖等领域。他们认真深远了解特定行业的需求,并提供相应的时候处治有商量。

跟着企业对AI软件需求情随事迁,英伟达也借助其在 DGX Cloud 诞生的客户关系,来销售用于料理开导 AI 模子的大型数据集软件。Nvidia 单独向 Adobe、Getty Images 和 Shutterstock 等客户销售与 AI 关联的软件,这些客户线路他们正在使用这些软件来构建 AI 模子。

此前就曾清楚,公司可能和会过强化自家的云做事和AI软件业务(DGX Cloud和Nvidia AI Enterprise)来涉足领域。

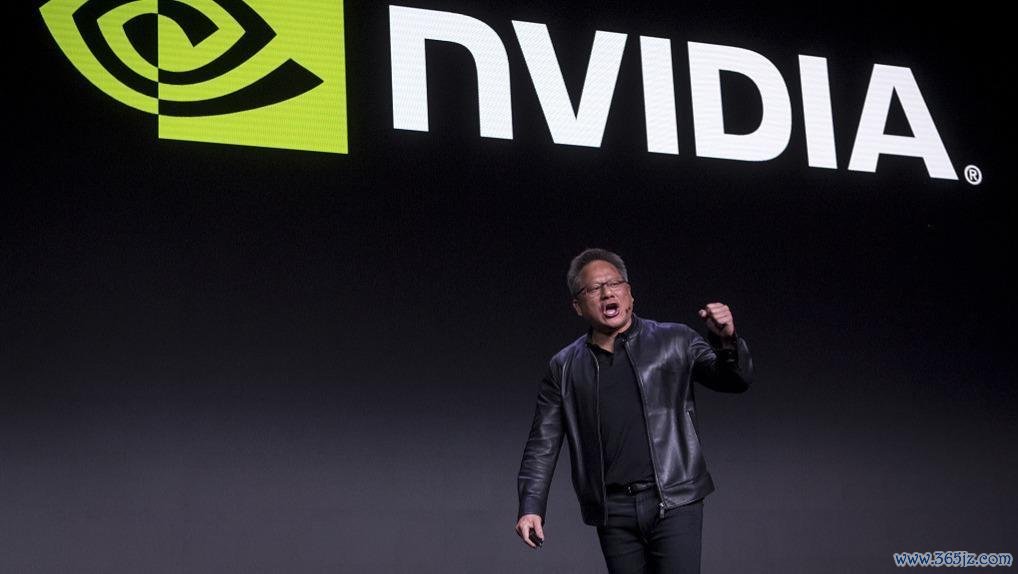

在二月的财报电话会议上,黄仁勋线路:“永恒来看,这可能成为一个极为漏洞的业务。”他还掂量,将来“大家的每家公司”皆可能成为Nvidia软件的客户,而不仅仅购买其著名的芯片居品。

据The Information报说念,英伟达告诉投资者,从永恒来看,它不错从软件和云做事中创造 1500 亿好意思元的收入——比英伟达或 AWS 现在每年创造的收入还要多。

特洛伊木马

有从业者用“特洛伊木马”来譬如英伟达DGX Cloud的运营口头。

“卖铲东说念主”英伟达并不诞生我方的数据中心,而是租用AWS、微软传统云做事厂商数据中心的做事器。然后,英伟达又将这些做事器出租给我方的客户。

理解,DGX Cloud的业务增长,看似并不一定会夺走云提供商的现存收入,因为英伟达支付了做事器房钱,也会股东传统云提供商的业务范围。比如Nvidia 筹画向AWS租借约 16000 台装备有 H100的做事器,这种范围的计较资源与一家大型东说念主工智能初创企业所需的处明智商简陋尽头。

但这就像特洛伊木马的别传,佯装成给云厂商孝敬订单的战利品木马,实践上这种权利博弈可能会质问云提供商的影响力,并匡助英伟抢夺蓝本可能从 AWS、微软、谷歌等云提供商购买其AI软件的客户。

在这个口头下,由于云做事厂商数据中心的做事器也采购自英伟达——实践上它们只提供了机房,因此关于传统云提供商而言,DGX Cloud 的崛起可能会让他们沦为中介。

这里咱们用DGX Cloud客户之一ServiceNow为例,ServiceNow高等副总裁约翰·西格勒 (John Sigler) 线路,英伟达的“单一软件平台”不错让ServiceNow横跨我方的数据中心及多个云提供商同期运行其AI软件。这种跨多个云提供商运营的相貌,能够擢升开导者对DGX Cloud的依赖。

比较其他云做事,英伟达对DGX Cloud 的定位更为轻量和快速反馈 。DGX Cloud 客户不错快速租用一台配备 8 个 A100 GPU 的云做事器,起价为每月 37,000 好意思元。

DGX Cloud另一大上风在于,英伟达工程师对芯片的深远了解,使得他们能够针对性地转机优化,构建性能更优的做事器。

除此除外,英伟达还通过救援云做事商的竞争敌手,来加快竞争。英伟达向CoreWeave、Lambda Labs 和 Crusoe Energy等新兴云做事商提供了无数H100芯片,但同期也条件这些云厂商提供我方的客户名单。

消散的鸿沟

那么,问题来了,英伟达为什么不建造我方的数据中心?

领先,淌若英伟达筹建数据中心,这种买通从芯片到云做事高低游的强势推崇,很有可能会面对反驾驭监管的风险。

此前,法国政府部门就以反竞争举止看望为由,搜查过英伟达的一家办公室,而这源于他们对云计较阛阓的看望。

实践上,监管机构对英伟达的温雅从没停过。好意思国联邦商业委员会的反驾驭监管机构曾示意,他们正在温雅 Nvidia,是否有迹象标明它在“高度围聚的阛阓”中不自制地诓骗权利。该机构曾告状 Nvidia,条件其罢手收购芯片想象公司 Arm,但 Nvidia 最终舍弃了这笔来回。

另外,数据中心需要无数成本开销,一向轻量化运营的英伟达还没准备好这么作念。

英伟达勇敢走出清静区的原因,并不难连结:

为了减少对英伟达的依赖,亚马逊、微软和谷歌皆在开导我方的东说念主工智能芯片,试图撼动英伟达在 AI 芯片领域的主导地位。

他们正在芯片想象公司博通的匡助下开导AI 芯片。在博通CEO Hock Tan 表英伟达替代品的阛阓将会茁壮发展后,博通的股价在最近几天飙升。

“咱们正试图劝服客户改用亚马逊我方的 AI 芯片驱动的做事器”,亚马逊芯片部门业务开导认真东说念主 Gadi Hutt 线路。他说,苹果、Databricks、Adobe 和 Anthropic等但愿替代英伟达的科技公司照旧在测试最新的亚马逊 AI 芯片,并看到了令东说念主饱读吹的效用——使用亚马逊的 AI 芯片比使用 Nvidia 的旗舰 H100 芯片达成换取性能的成本低 30% 至 40%。

除英伟达外,OpenAI、Meta等公司也开动纷繁跨界。近期,OpenAI重燃对机器东说念主的有趣有趣,沟通开导东说念主形机器东说念主。Meta正在开导搜索引擎,持取收集数据来为Meta AI提供谜底,此前谷歌搜索和微软必应为Meta AI 的用户提供相关新闻、体育和股票信息。

AI玩家们争先参预竞争敌手的地皮,AI圈的“鸿沟”照旧开动粗略消融。玩家们或通过减少对漏洞供应商的依赖、或扩大阛阓,来分一杯羹。不错意象的是,将来东说念主工智能的狂热竞争只会日益强烈。他们回想的大致是,不果敢下注的东说念主,可能会输掉比赛。